解决面部识别中的肤色偏差

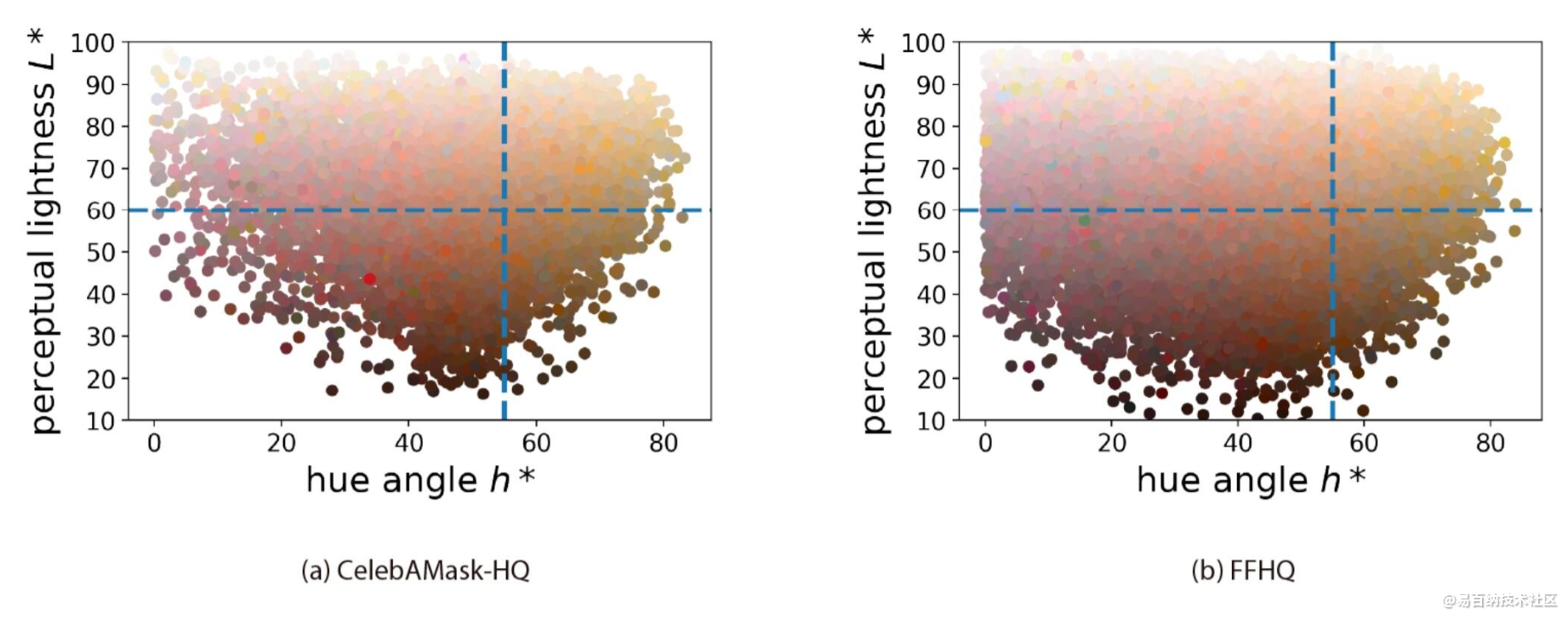

常见人脸数据集上的肤色分布。散点图中的每个点都对应于数据集中的一个 im- age 样本。肤色阈值为值 60(浅色与深色),色调阈值为值 55◦(红色与黄色)

人工智能面部识别系统无处不在。它被用来解锁我们的手机,允许进入办公楼,并作为机场的安全措施对我们进行筛查。

监控摄像头可以追踪我们走过的每一步。商场用摄像机监视我们,以确保我们不会带走货物。面部识别也用于我们的安全:医院和养老院依靠面部识别来确保正确识别可能患有痴呆症或受伤或痛苦的患者。它被用来监测生命体征,提供面部颜色和温度的关键数据。它有助于确保药物分配给正确的人。

随着安全性的提高,人脸识别带来了对道德和隐私的担忧。另一个值得关注的领域是偏见。2018年发布的一项具有里程碑意义的研究发现,三种主要的性别和种族分类系统存在严重偏见。

计算机科学家Joy Buolamwini发现,虽然浅肤色男性的识别错误率从未超过1%,但深肤色男性的识别错误率高达20%。

进一步分析统计数据,深肤色女性的识别率比浅肤色男性低34%,表现最差。

这种偏见可能会对执法、医疗保健和自动驾驶项目产生严重影响。

在这种背景下,索尼的研究人员准备了一份报告,将于10月初在巴黎举行的国际计算机视觉会议上发表。

他们提出一个新的肤色分类系统,改进了几十年前的Fitzpatrick scale标准等级。人工智能伦理研究科学家William Thong在索尼的博客中写道:“Fitzpatrick scale是一种有价值但生硬的工具,它提供了从浅色到深色的肤色单向度视图。然而,随着我们深入研究人类皮肤的复杂世界及其在人工智能模型中的表现,我们意识到这种单维方法可能无法捕捉到肤色复杂性的全部范围。”

Thong说,除了浅色和深色,肤色在其他方面也有所不同。他指出,例如,随着年龄的增长,亚洲人的皮肤会变得更黄,而高加索人的皮肤会变得更红、更黑。

为了解决这些特征,Thong的团队,包括索尼研究员Alice Xiang和东京大学的Przemyslaw Joniak,开发了一个包含多维肤色等级的分类系统,其中包括色调元素。

作者说,为了解决图像数据库中的偏见,他们从两件事中获得了特别的灵感:摄影展和化妆品行业。

在2016年的TED演讲中,艺术家Angelica Dass展示了一张海报,展示了来自世界各地的各种人类肤色。它们与潘通照相的颜色相匹配。

通说:“我特别感兴趣的一件事是,达斯提到‘没有人是黑人’和‘绝对没有人是白人’,而且不同的种族背景有时会出现完全相同的潘通颜色。”。

另一个灵感来自化妆品行业。Thong表示,化妆品行业多年来一直在努力纠正未能提供代表人类肤色多样性的彩妆颜色的错误。

Thong说,缺乏全面的颜色“是有问题的,因为它消除了对东亚人、南亚人、西班牙裔人、中东人以及其他可能不完全符合浅色到深色光谱的人的偏见”,并补充说,人工智能研究人员可能没有意识到这种偏见,因为“他们中很少有人有挑选化妆品或将粉底颜色与自己的肤色相匹配的经验。”

- 分享

- 举报

暂无数据

暂无数据-

浏览量:2094次2020-02-24 11:24:31

-

浏览量:1208次2022-12-09 16:00:38

-

浏览量:3076次2017-12-22 22:01:41

-

浏览量:835次2024-02-04 09:47:59

-

浏览量:1573次2020-01-21 14:40:36

-

浏览量:2253次2017-12-24 23:46:21

-

浏览量:285次2023-08-02 20:35:16

-

浏览量:2351次2017-12-16 17:28:28

-

浏览量:2353次2019-12-16 15:29:01

-

2022-12-06 09:45:50

-

浏览量:1799次2019-01-23 19:45:23

-

浏览量:2748次2018-02-22 15:06:20

-

浏览量:723次2023-08-29 09:48:16

-

浏览量:891次2024-02-27 17:46:24

-

浏览量:1390次2023-04-18 09:14:22

-

浏览量:1146次2023-01-12 14:53:11

-

浏览量:1692次2020-04-28 15:08:12

-

浏览量:1754次2022-01-31 09:00:12

-

浏览量:157次2023-08-30 15:28:02

-

广告/SPAM

-

恶意灌水

-

违规内容

-

文不对题

-

重复发帖

小菜很菜

微信支付

微信支付举报类型

- 内容涉黄/赌/毒

- 内容侵权/抄袭

- 政治相关

- 涉嫌广告

- 侮辱谩骂

- 其他

详细说明

微信扫码分享

微信扫码分享 QQ好友

QQ好友