向用户解释机器学习模型的交互式平台

机器学习模型现在通常用于各种专业领域,同时也支持许多智能手机应用程序、软件包和在线服务的功能。虽然大多数人都接触到这些模型并以某种形式与它们互动,但很少有人完全了解它们的功能和潜在过程。

此外,近年来,机器学习算法变得越来越复杂和复杂,即使是经验丰富的计算机科学家也难以解释其预测背后的过程。为了增加人们对这些高度先进和有前途的计算工具的信任,一些研究团队一直在尝试创造所谓的可解释人工智能(XAI)。

这些本质上是机器学习模型,至少可以部分解释它们是如何得出给定结论的,或者在做出特定预测时关注的是数据的哪些“特征”。虽然XAI技术可能更加健壮和可靠,但它们中的大多数并没有取得特别有希望的结果,因为它们的解释往往留下了解释的空间。

加州大学欧文分校(University of California-Irvine)和哈佛大学(Harvard University)的研究人员最近开发了TalkToModel,这是一个交互式对话系统,旨在向工程师和非专业用户解释机器学习模型及其预测。他们的平台发表在《自然机器智能》杂志上,用户可以通过该平台获得有关人工智能模型及其功能的简单而相关的答案。

“我们感兴趣的是找到更好地使模型可解释性的方法,”进行这项研究的研究人员之Dylan Slack告诉Tech Xplore。然而,从业者往往难以使用可解释性工具。因此,我们认为让从业者直接与机器学习模型‘对话’可能会更好。”

Slack和他的同事最近的研究建立在他们早期专注于XAI和人类人工智能交互的工作基础上。它的主要目标是引入一个新平台,以一种简单易用的方式向用户解释人工智能,类似于OpenAI的对话平台ChatGPT回答问题的方式。

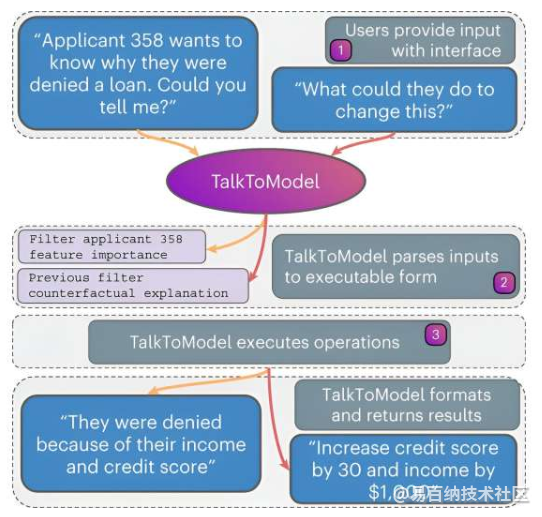

他们的系统有三个关键组件:自适应对话引擎、执行单元和对话接口。自适应对话引擎被训练成用自然语言解释输入文本,并对这些文本产生合理的反应。

执行组件本质上是由”人工智能解释”组成的,然后将其翻译为可访问的单词并发送给用户。会话界面本质上是一种软件,用户可以通过它输入提示并查看答案。

Slack解释说:“talktommodel是一个通过机器学习模型实现开放式对话的系统。“你只需问系统一个问题,关于你的模型为什么要做某件事,然后得到答案。这使得任何人都能很容易地理解模型。”

为了确定用户是否会觉得他们的系统有用,该团队请不同的专业人士和学生来测试并分享他们的反馈。总体而言,他们的大多数研究参与者发现它有点有用和有趣,73%的参与医护人员表示他们会用它来更好地理解基于人工智能的诊断工具的预测,85%的机器学习开发人员确认它比其他XAI工具更容易使用。

在未来,这个平台可以进一步改进并向公众发布。这可能有助于提高人们对人工智能的理解和对其预测的整体信任。

“我们对人类的研究发现,包括研究生、机器学习工程师和卫生保健工作者,真的很有趣,”Slack补充说。他们认为,该系统对任何人了解模型及其工作原理都非常有用。我们现在希望继续探索使用更先进的人工智能系统的方法,比如ChatGPT风格的模型,来改善这类系统的体验。”

- 分享

- 举报

暂无数据

暂无数据-

浏览量:642次2023-08-22 17:58:21

-

浏览量:2060次2019-11-12 09:52:00

-

浏览量:1258次2023-02-24 09:11:16

-

浏览量:944次2023-12-06 14:42:44

-

浏览量:1038次2023-01-12 17:13:47

-

浏览量:5003次2021-09-09 09:30:16

-

浏览量:1908次2020-01-08 09:25:44

-

浏览量:2472次2020-11-05 10:20:02

-

浏览量:635次2023-09-04 18:54:46

-

浏览量:1649次2023-02-13 10:31:50

-

浏览量:9768次2021-02-23 16:44:17

-

浏览量:5357次2021-06-07 09:28:15

-

浏览量:6133次2020-11-06 10:29:58

-

浏览量:3628次2020-12-02 11:48:26

-

浏览量:913次2024-02-02 17:26:56

-

浏览量:3249次2019-06-19 16:37:18

-

浏览量:126次2023-09-14 22:04:44

-

浏览量:1165次2023-09-04 16:04:31

-

浏览量:957次2023-03-01 09:36:58

-

广告/SPAM

-

恶意灌水

-

违规内容

-

文不对题

-

重复发帖

Mrs Wu

微信支付

微信支付举报类型

- 内容涉黄/赌/毒

- 内容侵权/抄袭

- 政治相关

- 涉嫌广告

- 侮辱谩骂

- 其他

详细说明

微信扫码分享

微信扫码分享 QQ好友

QQ好友