开源AI可解释性研究工具Tracr

DeepMind的研究人员开源了TRAnsformer Compiler for RASP(Tracr),这是一种将程序转换为神经网络模型的编译器。Tracr 旨在研究转换器 AI 模型(如 GPT-3)的机械可解释性。

Tracr 是限制访问序列处理 (RASP) 语言的编译器,该语言的开发是为了推理基于变压器的神经网络的运行方式;特别是解释为什么他们会产生他们所做的结果。Tracr允许研究人员在RASP中开发程序,然后将其编译成可运行的神经网络模型。目标是为评估AI可解释性工具提供“基本事实”模型。

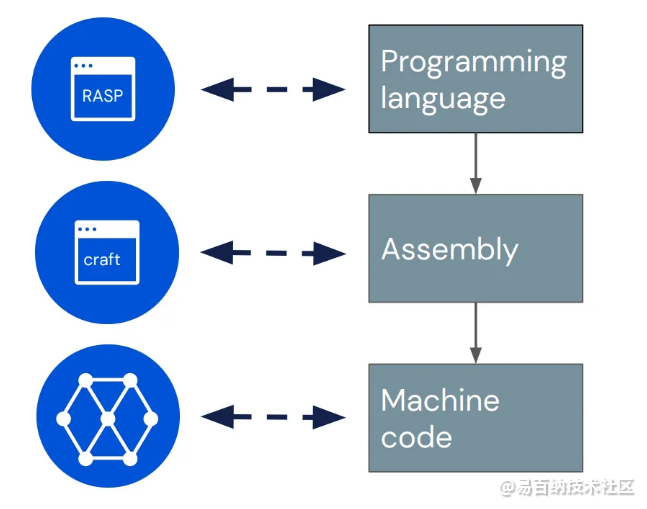

随着深度学习模型变得越来越大和复杂,解释它们如何以及为什么产生特定的输出变得越来越困难。对人工智能可解释性技术的研究正在进行中,并寻求多种途径。DeepMind团队开发了Tracr来帮助实现机械可解释性,它试图对深度学习模型进行“逆向工程”。编程中的类比是从二进制可执行文件对高级源代码进行逆向工程。

因此,Tracr的类比是提供一种评估机制解释器的方法,方法是从高级源代码开始并将其编译为二进制文件。如果解释器可以复制原始源代码,则证明解释器结果是可信的。

Tracr源代码类比

这个类比非常贴切,因为实际上Tracr是一种高级编程语言RASP的编译器。RASP 是一种用于指定转换器模型计算图的语言;RASP 基元映射到转换器组件,例如嵌入和注意力。RASP的开发旨在通过抽象计算的细节来允许研究人员“像变压器一样思考”。

继续编程类比,DeepMind团队为变形金刚创建了一个称为craft的“汇编语言”。模型在电路级别在工艺中指定;也就是说,完整神经网络的子图。Tracr编译器将模型的RASP规范转换为工艺,然后从工艺转换为具有具体权重的最终模型。

为了演示Tracr的使用,该团队实现了几个模型。虽然仅解码器的转换器模型通常用于自然语言处理(NLP)任务,如文本摘要或问答,但DeepMind研究人员使用Tracr创建模型更简单的任务:计算输入序列中的标记数量,对数字序列进行排序,并检查平衡括号。

除了用作测试可解释性工具的工具外,研究人员还指出了Tracr的其他潜在应用。例如,可以编译模型部分的手动编码实现,并用于替换由传统训练方法生成的模型部分;这可能会提高整体模型性能。

- 分享

- 举报

暂无数据

暂无数据-

浏览量:1936次2023-02-13 10:31:50

-

浏览量:1262次2023-06-02 17:41:27

-

浏览量:2166次2020-01-08 09:25:44

-

浏览量:1646次2022-12-06 19:29:47

-

浏览量:1321次2023-03-20 15:23:45

-

浏览量:197次2023-08-15 22:50:27

-

浏览量:2518次2020-07-03 14:29:26

-

浏览量:2870次2017-12-28 23:30:36

-

浏览量:353次2023-07-24 11:00:24

-

浏览量:4661次2021-07-02 14:29:37

-

浏览量:303次2023-08-22 15:12:16

-

浏览量:1946次2018-08-08 11:07:03

-

浏览量:6583次2021-08-03 11:36:37

-

浏览量:2250次2019-12-21 10:41:40

-

浏览量:2109次2018-12-29 15:12:37

-

浏览量:2144次2018-07-13 19:56:48

-

浏览量:775次2023-06-08 10:35:09

-

浏览量:393次2023-07-14 14:21:54

-

浏览量:174次2023-08-16 18:28:43

-

广告/SPAM

-

恶意灌水

-

违规内容

-

文不对题

-

重复发帖

艾

微信支付

微信支付举报类型

- 内容涉黄/赌/毒

- 内容侵权/抄袭

- 政治相关

- 涉嫌广告

- 侮辱谩骂

- 其他

详细说明

微信扫码分享

微信扫码分享 QQ好友

QQ好友